https://www.cnblogs.com/wisilian21/p/19726897

一、环境准备

1.1 硬件要求

NVIDIA GPU:建议显存 ≥8GB(如 RTX 2080Ti系列),用于流畅运行 7B~14B 量化模型。

内存:建议 ≥16GB(本文档使用 32GB 内存)。

磁盘空间:至少 20GB 剩余空间用于存放模型文件。

1.2 软件要求

操作系统:Windows 11(本文基于 Windows 11 测试)。

PowerShell:以管理员身份运行(部分操作需要)。

Node.js:≥18.0.0(用于安装 OpenClaw)。

https://github.com/coreybutler/nvm-windows/releases

Git(必选选,用于某些技能依赖)。下载地址:HTTPS://git-scm.com/。Windows 选择 64 位版本,安装时勾选 Add Git to PATH

使用 Winget 工具

如果还没有 安装winget工具,请先安装它,然后在命令提示符或Powershell中输入以下命令。

winget install --id Git.Git -e --source wingetnode –version # 应显示 v18 以上

npm –version # 应显示 8 以上

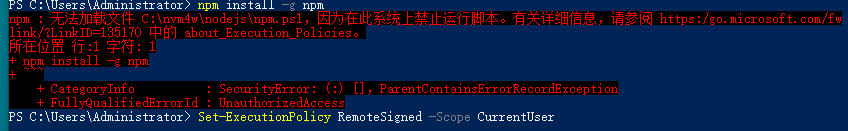

这是发生了错误

修改执行策略,允许运行信任的脚本

在管理员 PowerShell 中执行以下命令:

设置当前用户的执行策略为 RemoteSigned(允许运行本地脚本,远程脚本需签名)

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser执行后会弹出确认提示,输入 Y 并回车即可

关闭当前管理员 PowerShell,重新打开普通 PowerShell(或保持管理员窗口),再次执行:

npm install -g npm执行完升级命令后,输入以下命令查看 npm 版本,确认是否升级成功:

npm -v二、安装 Ollama 并下载模型

访问 ollama.com 下载 Windows 版本并安装,管理员打开powershell窗口执行(需要vpn代理FQ)

set http_proxy=http://127.0.0.1:7890

set https_proxy=http://127.0.0.1:7890

irm https://ollama.com/install.ps1 | iex

我没用到上面这些。我用的是下面的命令直接安装的,需以管理员 PowerShell 执行;

iwr -useb https://ollama.com/install.ps1 | iex安装后 Ollama 会自动注册为系统服务,开机自启。

验证安装:

ollama --version2.2 拉取基础模型(以 Qwen2.5 7B 为例)

ollama pull qwen3:8b等待下载完成(约 5.2 GB)。

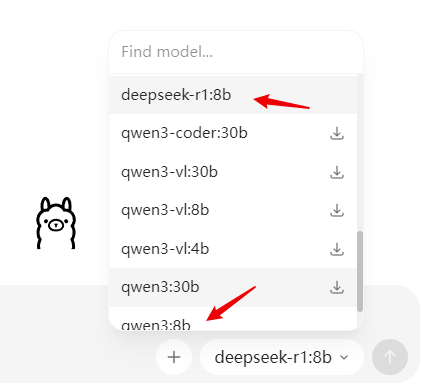

我是下载的这两个模型

ollama pull deepseek-r1:8bollama pull qwen3:8b

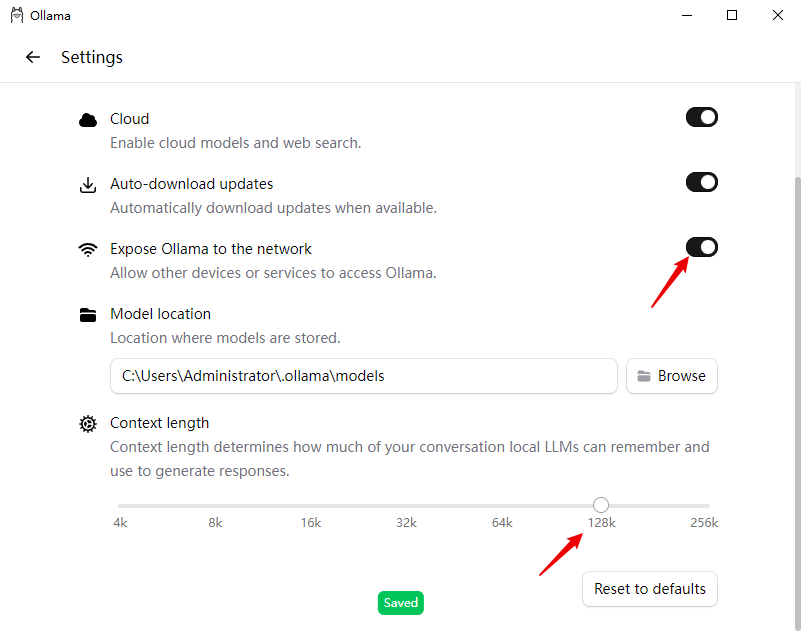

2.3 创建支持更大上下文窗口的模型(OpenClaw 要求 ≥16K)

OpenClaw 默认要求模型上下文窗口至少 16000 tokens,而基础模型可能只有 4096,因此需要创建自定义模型。

切换到用户目录(避免权限问题):

cd C:\Users\<你的用户名>

创建 Modelfile:

@"

FROM qwen3:8b

PARAMETER num_ctx 32768

"@ | Out-File -Encoding ascii Modelfile

查看文件内容确认:

Get-Content Modelfile

应显示:

FROM qwen3:8b

PARAMETER num_ctx 32768

创建新模型(例如 qwen3:8b-32k):

ollama create qwen3:8b-32k -f Modelfile

验证模型已创建并查看上下文参数:

ollama list # 应看到 qwen3:8b-32k

ollama show qwen3:8b-32k –modelfile # 确认包含 num_ctx 32768

注意:若创建时出现 unknown type 错误,请检查 Modelfile 是否包含不可见字符,或改用 -Encoding ascii 重新生成。