python

输入python3 –version,会弹出安装提示框

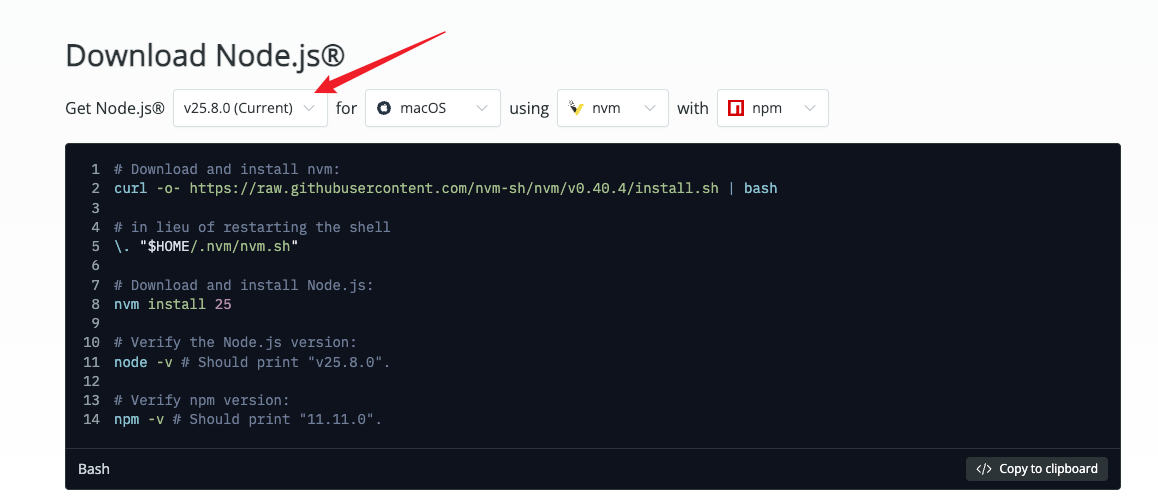

nodejs

网站 https://nodejs.org/

这里可以选择版本安装

一条命令一条命令的进行安装

# Download and install nvm:

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.4/install.sh | bash

# in lieu of restarting the shell

\. "$HOME/.nvm/nvm.sh"

# Download and install Node.js:

nvm install 25

# Verify the Node.js version:

node -v # Should print "v25.8.0".

# Verify npm version:

npm -v # Should print "11.11.0".homebrew

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"openclaw

curl -fsSL https://openclaw.ai/install.sh | bash设置openclaw为中文

切换语言:进入 Overview → 页面底部 Language → 选择 Simplified Chinese → 刷新页面。

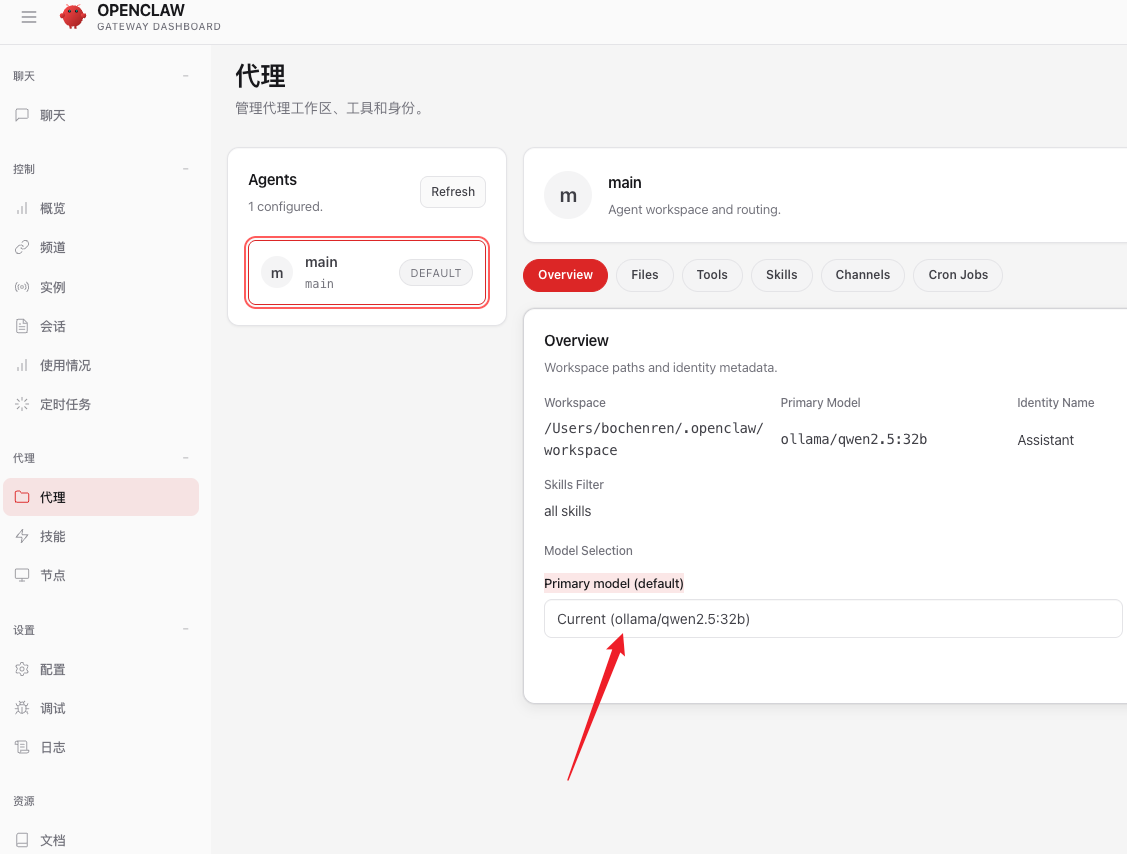

选择模型

设置tavily搜索

获取免费 API 密钥:

访问 app.tavily.com

注册账号并生成 API 密钥

配置方式(任选其一):

方法1: 环境变量

export TAVILY_API_KEY="tvly-你的密钥"

方法2: 配置到 OpenClaw 插件

openclaw configure –section plugins

验证配置:

echo $TAVILY_API_KEY

配置完成后,我可以为您搜索最新财经资讯。Tavily 的财经搜索功能可以获取:

股市动态

汇率变化

宏观经济新闻

行业分析

方式 A:使用交互式配置(推荐)

openclaw configure –section model

然后选择 Ollama 作为提供商。

方式 B:手动设置环境变量

export OLLAMA_API_KEY="ollama-local"

- 验证和设置默认模型

查看可用模型

openclaw models list

设置默认模型

openclaw models set ollama/glm-4.7-flash

查看状态

openclaw models status

- (可选) 修改配置文件

如果需要持久化配置,可以编辑配置:

openclaw config set agents.defaults.model.primary "ollama/glm-4.7-flash"

⚠️ 注意事项

不要用 /v1 结尾的 URL – OpenClaw 使用 Ollama 原生 API (http://localhost:11434),不是 OpenAI 兼容模式

确保 Ollama 正在运行 – ollama serve

本地模型需要足够内存 – 根据模型大小(7B 约需 8GB,20B 约需 24GB)

你的默认模型已切换为:ollama/qwen3.5:9b(本地运行)

当前会话还在用旧模型(qwen-portal/coder-model),因为它是网关重启前创建的。新会话会自动使用本地模型。

你现在可以:

开始新会话 – 会自动使用 qwen3.5:9b

手动切换模型 – 用 /model ollama/qwen3.5:9b

试试其他本地模型:

ollama/qwen3:8b (更快,更小)

ollama/qwen2.5:32b (更强,但需要更多内存)